In un precedente articolo, abbiamo parlato di come Ollama gestisce la memoria durante il caricamento e l’esecuzione dei modelli di linguaggio di grandi dimensioni (LLM).

Leggi

Tutti i risultati con a tema #ollama

In un precedente articolo, abbiamo parlato di come Ollama gestisce la memoria durante il caricamento e l’esecuzione dei modelli di linguaggio di grandi dimensioni (LLM).

Leggi

Guardare dietro le quinte di come funzionano i modelli di linguaggio di grandi dimensioni (LLM) è fondamentale per comprendere le loro prestazioni e limitazioni, e uno degli aspetti più critici è la gestione della memoria, che influisce direttamente sulla velocità di risposta e sulla capacità del modello di mantenere il contesto durante una conversazione.

Leggi

📚 In questa serie — Ollama 101: Ollama 101 - Cos’è e come usarlo Ollama 101 - Usarlo tramite CLI Ollama 101 - Usarlo tramite REST API Ollama 101 - Mastering CLI ← sei qui!

Leggi

📚 In questa serie — Ollama 101: Ollama 101 - Cos’è e come usarlo Ollama 101 - Usarlo tramite CLI Ollama 101 - Usarlo tramite REST API ← sei qui!

Leggi

📚 In questa serie — Ollama 101: Ollama 101 - Cos’è e come usarlo Ollama 101 - Usarlo tramite CLI ← sei qui!

Leggi

📚 In questa serie — Ollama 101: Ollama 101 - Cos’è e come usarlo ← sei qui!

Leggi

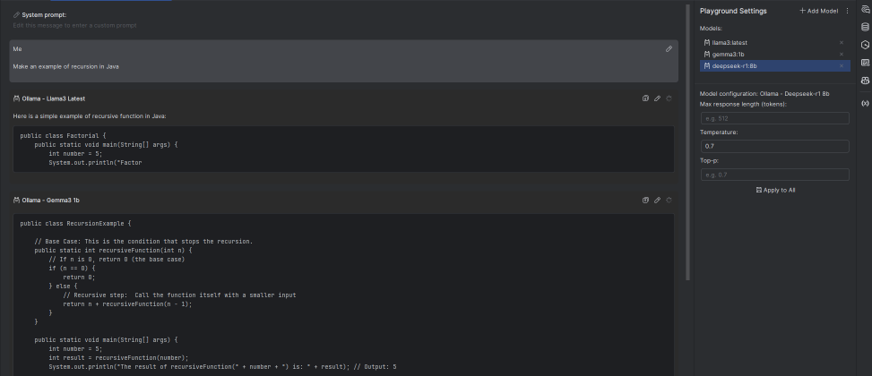

Hai già provato AI Playground di PyCharm? Scopri come usarlo con i modelli locali di Ollama per uno sviluppo assistito da LLM!

LeggiCommunity, aziende e persone che supportano attivamente il blog

Scrivici a collaborazioni[at]theredcode.it con una proposta: idea, taglio del contenuto e una breve presentazione. Non vediamo l'ora di leggere la tua esperienza!

Invia la tua idea